🎬 本記事の内容をAIクリエーターの道が独自の視点で深掘りディスカッションしています。記事では詳細なデータと参照リンクをまとめています。

はじめに:この記事が解決する問題

生成AIは「なんとなく便利そう」という段階を超え、実務の中核に組み込まれつつある。野村総合研究所の2025年IT活用実態調査によれば、日本企業の生成AI導入率は57.7%に達し、「導入済み」と「導入検討中」を合わせると76%に上る(出典:NRI IT活用実態調査 2025年)。しかしPwCの5カ国比較調査が示すとおり、日本企業が「効果を実感している」割合は米英の4分の1にとどまっている(出典:PwC 生成AIに関する実態調査 2025春)。

このギャップの原因は「ツールの使い方」ではなく「技術の原理を理解し、適切にリスクを管理しながら業務プロセスに統合する設計力」の不足にある。本記事は、生成AIの技術原理を構造的に解説し、実務で即座に活用できるフレームワークを提示し、リスク管理の具体的な手順を示すことで、読者がこのギャップを埋めるためのリファレンスとなることを目的としている。

対象読者は、aicreator-path.comの既存記事を読む実務エンジニア、技術リーダー、およびAIを業務に導入する意思決定者である。「初心者向け入門」ではなく「実務者が技術を正確に理解し、チームに説明し、導入判断を下すための実用文書」として設計した。

第1章:生成AIとは何か──従来AIとの構造的な違い

1-1. 定義と分類

AI(人工知能)は大きく「識別系AI」と「生成系AI」に分類できる。識別系AIは入力データを分類・予測するもので、スパムフィルタや画像認識がこれに該当する。入力に対してラベルや数値を返す。一方、生成系AI(Generative AI)は入力に対して新しいコンテンツ──テキスト、画像、音声、動画、コード──を生成して返す。

この違いは単なる出力形式の差ではない。識別系AIは「この画像は猫である確率92%」のように既存カテゴリへのマッピングを行うのに対し、生成系AIは「猫が宇宙船を操縦している画像」のように訓練データに存在しない新しいコンテンツを創出する。つまり、入力空間から出力空間への写像の性質が根本的に異なる。

1-2. なぜ今、生成AIが爆発的に普及したのか

生成AI自体の研究は数十年の歴史があるが、2022年末のChatGPT公開を契機に一般社会へ急速に浸透した。この爆発的普及を支えた三つの構造的要因がある。

第一に、計算資源の飛躍的拡大である。NVIDIAのGPU(特にA100、H100世代)により、数千億パラメータのモデルを現実的な時間とコストで訓練できるようになった。

第二に、訓練データの大規模化である。インターネット上のテキスト、画像、コードなど、膨大なデータセットが利用可能になり、モデルが多様なパターンを学習できる基盤が整った。

第三に、そして最も決定的な要因が、2017年にGoogleの研究者8名が発表した論文「Attention Is All You Need」で提案されたTransformerアーキテクチャである(出典:Vaswani et al., 2017, arXiv:1706.03762)。この11ページの論文が、現在の生成AI時代の出発点となった。

第2章:Transformerの技術原理──Self-Attentionが変えたすべて

2-1. Transformerが解決した問題

Transformer以前、自然言語処理の主流は**RNN(再帰型ニューラルネットワーク)**であった。RNNは文を左から右へ順番に処理するため、二つの根本的な制約を抱えていた。長い文の前半の情報が後半に到達するまでに薄れる「長期依存性の問題」と、順次処理ゆえに並列化できず訓練に時間がかかる「計算効率の問題」である。

TransformerはこれらをSelf-Attention(自己注意)機構によって一挙に解決した。文全体を同時に処理し、各トークン(単語やサブワード)がすべての他のトークンとの関連度を計算する。これにより、文の冒頭の単語と末尾の単語の関係も直接的に捉えられ、並列計算によって訓練速度も劇的に向上した。

2-2. Self-Attentionの仕組み:Query・Key・Value

Self-Attentionの核心は、各トークンに対して三つのベクトル──Query(Q)、Key(K)、Value(V)──を生成し、以下の計算を行う点にある。

Attention(Q, K, V) = softmax(QK^T / √d_k) V

直感的に説明すると、Queryは「このトークンは何を探しているか」、Keyは「このトークンはどんな情報を持っているか」、Valueは「このトークンが実際に伝える内容」に相当する。QとKの内積によって「どのトークン間の関連が強いか」のスコア(Attention Score)が計算され、そのスコアに基づいてValueの重み付け合計が出力される。√d_kによる除算はスコアのスケーリングで、softmaxの勾配消失を防ぐ役割を持つ。

Financial Timesの解説記事が示す具体例が分かりやすい(出典:FT “Generative AI exists because of the transformer”)。”She showed no interest in the rate the bank was offering” という文において、”interest” というトークンのQueryが文中の他のトークンのKeyと照合されると、”rate” と “bank” のAttention Scoreが高くなる。これにより、モデルは “interest” が「興味」ではなく「金利」の意味で使われていると理解する。文脈を変えて “She showed no interest in politics” とすれば、”no” と “in” のスコアが高くなり、「興味」の意味だと解釈される。

2-3. Multi-Head Attentionとレイヤー構造

実際のTransformerは、単一のAttentionではなく複数の「ヘッド」を並列に走らせるMulti-Head Attentionを採用している。各ヘッドが異なる種類の関係(構文的な関係、意味的な関係、共参照関係など)を独立して学習し、最終的にそれらを結合する。論文のオリジナルモデルでは8ヘッドが使用された。

Transformerブロックは、Multi-Head Attention層とFeed-Forward Network(FFN)層で構成され、これらが残差結合(Residual Connection)と層正規化(Layer Normalization)で接続される。このブロックを複数段(GPT系モデルでは数十〜百段以上)積み重ねることで、低次の文法的パターンから高次の意味的パターンまでを階層的に学習する。

2-4. 位置エンコーディング

Transformerは文全体を同時に処理するため、トークンの順序情報が失われる。これを補うのが**位置エンコーディング(Positional Encoding)**で、各トークンの位置に応じた固有のベクトルをトークンの埋め込みに加算する。オリジナル論文ではサイン関数とコサイン関数を用いた固定的なエンコーディングが提案されたが、現在のモデルの多くは学習可能な位置エンコーディングやRoPE(Rotary Position Embedding)などを採用している。

第3章:生成AIのモデル体系──LLMから拡散モデルまで

3-1. 大規模言語モデル(LLM)

LLM(Large Language Model)はTransformerのデコーダ部分を大規模化したモデルで、テキスト生成を行う。訓練時に膨大なテキストデータから「次のトークンを予測する」タスク(Next Token Prediction)を繰り返し、言語のパターンを学習する。

現在の主要LLMとその位置づけは以下のとおりである。

OpenAI GPTシリーズ:GPT-4o(マルチモーダル対応、テキスト・画像・音声の統合処理)が主力。API価格は入力$5/100万トークン、出力$10/100万トークン程度。汎用性が最も高く、特に創造的なタスクとマルチモーダル処理に強い(出典:Intuition Labs AI API Pricing Comparison)。

Anthropic Claude シリーズ:Claude Opus 4.6が最上位モデル。複雑な推論とコーディングに優れ、長文コンテキスト(20万トークン)を安定処理できる。API価格は入力$15/100万トークンとやや高価だが、精度重視のエンタープライズ用途で評価が高い。

Google Gemini シリーズ:Gemini 2.5 Flash は入力$0.075/100万トークンと圧倒的に安価で、Googleサービスとの連携とマルチモーダル処理に強い。コスト効率を重視する大量処理に適している。

重要な点は、どのモデルが「最強」かではなく、用途とコストに応じて適切なモデルを選択する設計力が求められるということである。

3-2. 拡散モデル(Diffusion Model)

画像生成AIの主流は**拡散モデル(Diffusion Model)**である。IBMの技術解説によれば、拡散モデルは「訓練データにランダムなノイズを段階的に加え(Forward Process)、そのノイズ除去プロセスを逆方向に学習する(Reverse Process)」ことで画像を生成する(出典:IBM “What are Diffusion Models?”)。

直感的に説明すると、写真を徐々にぼかして最終的に完全なノイズにする過程を「前向き拡散」と呼ぶ。モデルはこの過程の各段階で「どのノイズが加えられたか」を学習し、推論時には完全なノイズから逆方向に少しずつノイズを除去して画像を復元する。テキストプロンプトで制御するText-to-Image生成では、CLIP等のモデルがテキストの意味を画像生成プロセスに反映させる。

代表的なサービスとして、Midjourney(芸術性の高い画像生成)、DALL-E 3(OpenAI、ChatGPTと統合)、Adobe Firefly(商用利用のライセンスが明確)、Stable Diffusion(オープンソース、ローカル環境で実行可能)がある。

3-3. その他のモデル:動画・音声・コード

動画生成ではOpenAI SoraやRunway Gen-3が、テキストから動画を生成する技術をリードしている。音声では、テキスト読み上げ(TTS)に強いElevenLabsや、音楽生成のSunoがある。コード生成では、GitHub Copilot(OpenAIベース)やCursor(マルチモデル対応のAI IDE)が開発現場に浸透しつつある。

第4章:実務活用フレームワーク──導入判断から運用設計まで

4-1. 導入判断の3軸評価

生成AIの導入を検討する際、以下の3軸で評価することを推奨する。

軸1:タスクの反復性と定型度 ── 反復的かつ定型的なタスク(メール文面の下書き、議事録要約、テストコード生成)は生成AIの効果が最も高い。総務省の令和7年版情報通信白書によれば、日本企業で生成AIを業務使用している割合が最も高いのは「メールや議事録、資料作成等の補助」(47.3%)である(出典:総務省 令和7年版情報通信白書)。

軸2:エラーの許容度 ── 生成AIの出力には必ず誤りが含まれる可能性がある。社内向けブレインストーミングであればエラー許容度は高いが、顧客向け契約書や医療診断補助では極めて低い。エラー許容度が低いタスクには、後述するRAG(検索拡張生成)やHuman-in-the-Loop(人間による最終確認)の設計が不可欠となる。

軸3:データ機密性 ── 外部APIに送信するデータの機密性を評価する。@IT(アットマークIT)の2026年2月の調査記事によれば、主要6サービスのデータ利用ポリシーとオプトアウト手順はそれぞれ異なり、「シャドーAI」(組織の管理外で個人がAIツールを使用する状態)のリスクが深刻化している(出典:@IT 生成AI 6大サービス比較 2026年2月版)。

4-2. プロンプトエンジニアリングの実践原則

生成AIから高品質な出力を得るためのプロンプト設計には、以下の原則がある。

明確な役割定義:モデルに明示的な役割を与える。「あなたはシニアPythonエンジニアです。以下のコードをレビューしてください」のように、専門性と期待される振る舞いを指定する。

構造化された指示:期待する出力のフォーマットを明示する。「JSON形式で、キーは name, severity, suggestion の3つとし、severity は critical / warning / info の3段階とすること」のように、出力形式を制約することで精度が向上する。

Few-Shot Examples(少数例示):期待する入出力のペアを数例示すことで、モデルの振る舞いを誘導する。特に分類タスクやフォーマット変換で効果が高い。

Chain-of-Thought(段階的思考):「まず問題を分解し、各ステップの推論過程を明示してから最終回答を出すこと」と指示することで、複雑な推論タスクの精度が向上する。

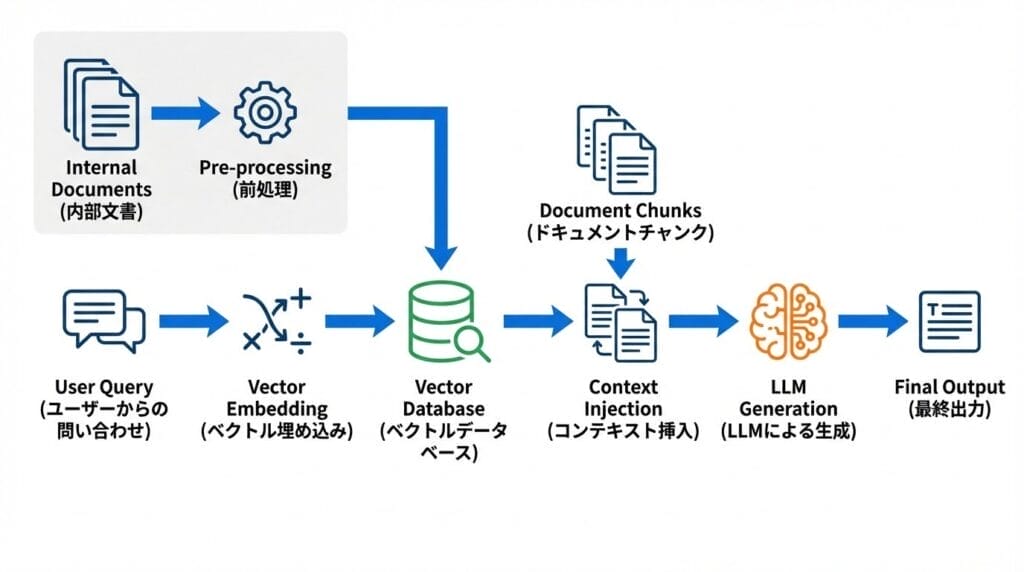

4-3. RAG(検索拡張生成)による精度向上

RAG(Retrieval-Augmented Generation)は、LLMの生成プロセスに外部知識ベースからの検索結果を組み込むアーキテクチャである。Forbesの解説によれば、2021年の研究でRAGにより質疑応答タスクのハルシネーションが35%削減されたと報告されている(出典:Forbes “How Retrieval-Augmented Generation Could Stop AI Hallucinations”, 2025年6月)。

RAGの基本的な処理フローは以下のとおりである。ユーザーの質問をベクトル化し、事前にベクトル化された社内文書データベースから類似度の高い文書断片を検索する。検索結果をプロンプトのコンテキストとしてLLMに渡し、LLMはそのコンテキストに基づいて回答を生成する。これにより、モデルの訓練データに含まれない最新情報や社内固有の情報にも基づいた回答が可能になる。

企業での実装には、ベクトルデータベース(Pinecone、Weaviate、pgvector等)の構築、文書のチャンキング(適切な単位での分割)設計、そしてプロンプトテンプレートの最適化が必要となる。

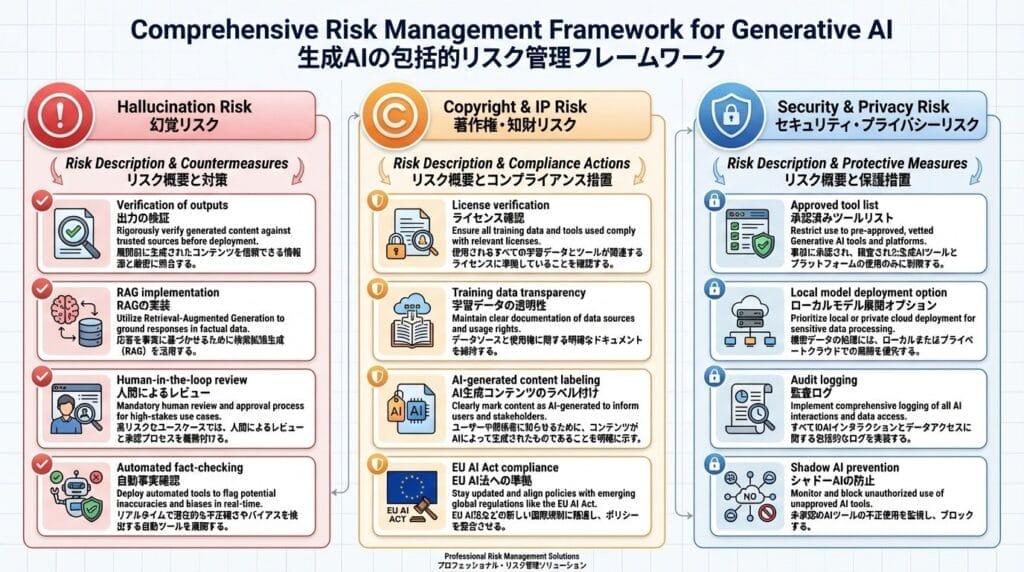

第5章:リスク管理──ハルシネーション・著作権・セキュリティ

5-1. ハルシネーション(事実と異なる出力)

ハルシネーションは生成AIの構造的な特性であり、完全に排除することは現時点で不可能である。LLMは「次のトークンとして最も確率の高いものを選ぶ」パターンマッチングエンジンであり、事実データベースではない。Financial Timesの解説が指摘するとおり、「もっともらしいが存在しないURLや判例を生成する」事例は後を絶たない(出典:FT “Generative AI exists because of the transformer”)。

Gibson Dunn法律事務所が2026年1月に公開した資料は、ハルシネーションが法的リスクに直結する事例を体系的に整理している(出典:Gibson Dunn “AI Hallucinations: Policies & Practice”, 2026年1月22日)。

実務的な対策チェックリスト:

対策1として、出力に含まれる固有名詞、数値、URL、引用は必ず一次ソースで検証する。対策2として、前述のRAGアーキテクチャにより、モデルが参照した文書を出力に紐付け、トレーサビリティを確保する。対策3として、重要な業務出力にはHuman-in-the-Loop(人間による最終レビュー)を必須プロセスとして組み込む。対策4として、ユニットテスト(コード生成の場合)や自動ファクトチェックツールによる検証レイヤーを追加する。

5-2. 著作権と知的財産

生成AIの著作権問題は、2026年において最も活発な法的議論の一つである。欧州議会は2026年1月28日、EU著作権法を全ての生成AIシステムに適用すべきとの見解を示し、EU域外で訓練されたモデルにも域内で提供される場合は規制を適用する方針を表明した(出典:European Parliament Press Release, 2026年1月28日)。

EU AI Act は段階的に施行が進んでおり、2026年8月からは高リスクAIシステムに関する規則が発効する。訓練データソースの開示義務、著作権オプトアウトの尊重、AI生成コンテンツのラベリング要件が含まれる(出典:IBM “What is the EU AI Act?”)。

日本では、2025年6月に「人工知能関連技術の研究開発及び活用の推進に関する法律(AI推進法)」が公布され、同年9月に全面施行された。罰則を伴わない枠組みだが、総務省・経済産業省のAI事業者ガイドライン(現在1.1版)と併せて、事業者の自主的なガバナンス構築を求める方向性が明確化されている(出典:経済産業省 AI事業者ガイドライン 第1.1版)。さらに日経新聞は2026年2月15日、AIエージェントやロボAIに対応する形でガイドラインの更新が3月末にも予定されていると報じている(出典:日本経済新聞 2026年2月15日)。

実務的な対策として、生成AIで作成したコンテンツの商用利用にあたっては、使用するサービスの利用規約とライセンス条件を確認すること、訓練データの出所が明確なサービス(例:Adobe Fireflyはライセンス済みデータのみで訓練)を選択すること、社内でAI生成コンテンツのラベリングポリシーを策定することが推奨される。

5-3. セキュリティとプライバシー

SecurePrivacy.aiの2026年2月のレポートは、生成AIが従来のデータ保護リスクを増幅させると警告している。ユーザーのプロンプトに個人情報が含まれることで第三者プロバイダーへのデータ流出が発生し、AI生成の出力にハルシネーションとして架空の個人データが含まれるリスクがある(出典:SecurePrivacy.ai “AI Risk & Compliance 2026”, 2026年2月3日)。

Kiteworksの調査によれば、生成AIユーザーの約半数が組織の管理外の個人向けAIアプリケーション(シャドーAI)を使用している(出典:Kiteworks “2026 AI Data Crisis”, 2026年1月9日)。

実務的な対策として、組織内で承認済みAIツールのリストを策定し、API経由での利用を標準化すること、機密データはローカル環境で動作するモデル(Ollama + オープンソースモデル等)で処理する選択肢を確保すること、利用ログの監査と定期的なポリシーレビューを実施する体制を構築することが必要である。

第6章:経済的インパクト──マクロデータが示す現実

生成AIの経済的影響に関する主要な推計を整理する。

Goldman Sachsは2023年の報告書で、生成AIが世界のGDPを7%押し上げる可能性があり、先進国の3億人相当のフルタイム労働者がオートメーションの影響を受けると推計した。同時に、米国と先進国の労働生産性を約15%向上させると予測している(出典:Goldman Sachs “Generative AI could raise global GDP by 7%”, 2023年4月、Goldman Sachs “How Will AI Affect the Global Workforce”, 2025年8月)。

McKinsey Global Instituteは、生成AIが63の分析対象ユースケースで年間2.6兆〜4.4兆ドルの経済価値を創出し得ると推計している(出典:McKinsey “The economic potential of generative AI”, 2023年6月)。

これらの推計が示すのは「AIで仕事がなくなる」という単純な未来像ではなく、「AIを活用できる人材とそうでない人材の間に、生産性の構造的な格差が生まれる」という現実である。aicreator-path.comの蒸留攻撃記事やAIコーディング記事で繰り返し指摘してきたとおり、実務者に求められるのはAIを「使う」スキルではなく、AIを「管理し、検証し、業務プロセスに統合する」スキルである。

第7章:規制の現在地──EU AI Act・日本AI推進法・米国の動向

世界の生成AI規制は2026年、実施段階に入っている。

EUでは、AI Act(規則 (EU) 2024/1689)の段階的施行が進行中である。2026年8月には高リスクAIシステムに関する規則が発効し、加盟国は同日までに少なくとも一つの「AI規制サンドボックス」を国内に設置する義務がある(出典:EU AI Act Article 57)。Baker Donelsonの2026年法務予測レポートは、EU AI Actに加え、米国コロラド州AI法が2026年6月に施行予定であることを報じている(出典:Baker Donelson “2026 AI Legal Forecast”, 2026年1月6日)。

日本では、前述のAI推進法が2025年9月に全面施行されているが、罰則を伴わない「ソフトロー」アプローチを採用しており、EU型のハードローとは異なる。ただし、AI事業者ガイドラインの継続的更新を通じて実質的なガバナンス基準が形成されつつあり、2026年3月末のガイドライン更新ではAIエージェントへの対応が盛り込まれる見通しである。

実務者が押さえるべきポイントは、特定の法律の条文ではなく「透明性(訓練データの開示)」「説明責任(出力の検証可能性)」「データ保護(プライバシー・セキュリティ)」という三原則がグローバル共通で収斂しているという構造的傾向である。この三原則を自社のAI運用に組み込んでおけば、各国の規制がどのように変化しても対応可能な基盤となる。

第8章:ツール選定フレームワーク──「何を使うか」ではなく「どう選ぶか」

特定のツール名は技術進化とともに急速に変化するため、エバーグリーンな選定フレームワークを提示する。以下の5つの評価軸で任意のツールを評価できる。

評価軸1:タスク適合性 ── テキスト生成、画像生成、コード補完、音声生成、動画生成のうち、自身のユースケースに最も適合するモデルを選ぶ。汎用性の高いマルチモーダルモデルか、特定領域に特化したモデルかの判断がここに含まれる。

評価軸2:コスト構造 ── API利用料(トークン単価)、サブスクリプション料金、インフラコスト(ローカル実行の場合のGPU費用)を比較する。処理量が多い場合、トークン単価の差が月額数百ドルの差を生む。

評価軸3:データポリシー ── 入力データの利用規約(モデル訓練への使用可否)、オプトアウト手順の明確さ、データの地理的保管場所を確認する。

評価軸4:統合性 ── 既存の開発環境(IDE、CI/CDパイプライン)やビジネスツール(Slack、Notion、Google Workspace)との連携の容易さ。API の安定性とドキュメントの充実度も含む。

評価軸5:出力品質と検証可能性 ── 自社のタスクで実際にベンチマークテストを行い、出力品質を定量評価する。ハルシネーション率、コード生成の正確性、指示遵守率などを計測する。

このフレームワークに基づいて定期的に評価を更新すれば、新しいモデルやサービスが登場しても、感覚的な「乗り換え」ではなく根拠に基づいた選定が可能になる。

第9章:実務者のためのアクションガイド──明日から始める3ステップ

ステップ1:小さく始める(1週間)

チーム内で一つの定型タスク(例:コードレビューコメントの下書き、議事録の要約、テストケースの生成)を選び、生成AIを試験的に適用する。出力の品質を毎回記録し、「修正にかかった時間」と「ゼロから作った場合の時間」を比較する。1週間の試験で、効果のあるタスクとないタスクが明確になる。

ステップ2:ガイドラインを策定する(2〜4週間)

試験結果をもとに、チーム内のAI利用ガイドラインを文書化する。含めるべき項目は、承認済みツールのリスト、入力してはならないデータの種類(個人情報、機密コード等)、出力の検証プロセス(誰が・いつ・どのように確認するか)、成果物にAI利用を表記するかどうかのポリシーである。

ステップ3:計測と改善を回す(継続)

月次で「AI導入前後のタスク処理時間」「AIの出力で修正が必要だった割合」「チームの満足度」を計測する。これらのKPIに基づいてツールの選定やプロンプトテンプレートを改善する。PDCAサイクルを回すことで、生成AIの活用は属人的な「使い方のコツ」から組織的な能力へ昇華する。

まとめ:生成AIは「知性の自転車」である

スティーブ・ジョブズはコンピュータを「知性の自転車」と呼んだ。生成AIはこの比喩をさらに押し広げる存在である。自転車は乗り手のペダリングを効率的な移動に変換するが、行き先を決めるのは乗り手自身であり、交通ルールを守るのも乗り手の責任である。

生成AIの技術原理を理解し、業務プロセスに適切に統合し、リスクを管理できる実務者こそが、Goldman SachsやMcKinseyが予測する生産性向上の果実を享受できる。本記事がそのためのリファレンスとなれば幸いである。

出典一覧

- Vaswani, A. et al. (2017). “Attention Is All You Need.” arXiv:1706.03762. https://arxiv.org/abs/1706.03762

- Financial Times. “Generative AI exists because of the transformer.” https://ig.ft.com/generative-ai/

- Goldman Sachs. (2023). “Generative AI could raise global GDP by 7%.” https://www.goldmansachs.com/insights/articles/generative-ai-could-raise-global-gdp-by-7-percent

- Goldman Sachs. (2025). “How Will AI Affect the Global Workforce.” https://www.goldmansachs.com/insights/articles/how-will-ai-affect-the-global-workforce

- McKinsey Global Institute. (2023). “The economic potential of generative AI.” https://www.mckinsey.com/capabilities/tech-and-ai/our-insights/the-economic-potential-of-generative-ai-the-next-productivity-frontier

- 野村総合研究所. (2025). “IT活用実態調査(2025年).” https://www.nri.com/jp/news/newsrelease/20251125_1.html

- PwC. (2025). “生成AIに関する実態調査 2025春 5カ国比較.” https://www.pwc.com/jp/ja/knowledge/thoughtleadership/generative-ai-survey2025.html

- 総務省. (2025). “令和7年版 情報通信白書.” https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r07/html/nd112220.html

- 経済産業省. (2025). “AI事業者ガイドライン 第1.1版.” https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20250328_2.pdf

- European Parliament. (2026). “Protect copyrighted work used by generative AI.” https://www.europarl.europa.eu/news/en/press-room/20260126IPR32636/

- IBM. “What is the EU AI Act?” https://www.ibm.com/think/topics/eu-ai-act

- IBM. “What are Diffusion Models?” https://www.ibm.com/think/topics/diffusion-models

- Forbes. (2025). “How Retrieval-Augmented Generation Could Stop AI Hallucinations.” https://www.forbes.com/councils/forbestechcouncil/2025/06/23/how-retrieval-augmented-generation-could-solve-ais-hallucination-problem/

- Gibson Dunn. (2026). “AI Hallucinations: Policies & Practice.” https://www.gibsondunn.com/wp-content/uploads/2026/02/WebcastSlides-AI-Hallucinations-Policies-Practice-22-JAN-2026.pdf

- SecurePrivacy.ai. (2026). “AI Risk & Compliance 2026.” https://secureprivacy.ai/blog/ai-risk-compliance-2026

- Kiteworks. (2026). “2026 AI Data Crisis.” https://www.kiteworks.com/cybersecurity-risk-management/ai-data-security-crisis-shadow-ai-governance-strategies-2026/

- @IT. (2026). “生成AI 6大サービス比較 2026年2月版.” https://atmarkit.itmedia.co.jp/ait/articles/2602/13/news015.html

- Baker Donelson. (2026). “2026 AI Legal Forecast.” https://www.bakerdonelson.com/2026-ai-legal-forecast-from-innovation-to-compliance

- EU AI Act Portal. https://artificialintelligenceact.eu/

- 日本経済新聞. (2026). “AIエージェントやロボAI『人の判断必須の仕組みを』政府指針に明記.” https://www.nikkei.com/article/DGXZQOUA136YP0T10C26A2000000/

- Intuition Labs. “AI API Pricing Comparison.” https://intuitionlabs.ai/articles/ai-api-pricing-comparison-grok-gemini-openai-claude

Q&A

Q1:生成AIは無料で使えますか? A1:主要サービス(ChatGPT、Gemini、Claude)はいずれも無料プランを提供しているが、利用回数やモデル性能に制限がある。業務利用には有料プラン(月額$20前後)またはAPI利用が現実的である。

Q2:生成AIの出力をそのまま商用利用して問題ないですか? A2:サービスごとに利用規約が異なる。OpenAIとAnthropicはAPI経由の出力に対して商用利用を許可しているが、出力の正確性に関する保証はない。画像生成では、訓練データのライセンスが明確なAdobe Firefly等を選択することで著作権リスクを低減できる。最新のEU規制動向も定期的に確認すべきである。

Q3:RAGの導入にはどの程度の技術力が必要ですか? A3:基本的なRAGパイプラインは、ベクトルデータベース(pgvector等)とLLMのAPI呼び出しで構成できるため、Webアプリケーションの開発経験があれば構築可能である。ただし、チャンキング戦略の最適化やリランキングの導入など、精度を高めるチューニングには自然言語処理の知識が求められる。

Q4:自社の機密データをAIに入力しても大丈夫ですか? A4:外部APIへの直接入力はリスクがある。各サービスのデータポリシーを確認し、オプトアウト設定を行うこと。高い機密性が求められる場合は、ローカル環境でオープンソースモデル(Llama、Mistral等)を実行する方法がある。

Q5:この分野の情報をどう追い続ければよいですか? A5:aicreator-path.comでは日々のAIニュースを速報記事とポッドキャストで配信し、本記事のようなエバーグリーン記事で技術原理と実務フレームワークを体系的にまとめている。速報で最新動向を把握し、エバーグリーン記事で構造的理解を深める二層構造での情報収集を推奨する。

本記事はAIの補助を受けて作成されています。すべてのデータと引用は出典を明示しており、最終的な内容の正確性については筆者が責任を負います。

最終更新:2026年2月

※本記事は定期的に更新されます。ツール情報や規制動向は変化が速いため、出典リンクから最新情報を確認してください。

AI関連の最新動向を毎日短くまとめてXで配信しています。

記事では書ききれない速報や所感も流しているので、気になる方はフォローしてみてください。

AI関連の最新動向を音声で毎日配信中です。

→ Spotifyでフォローする